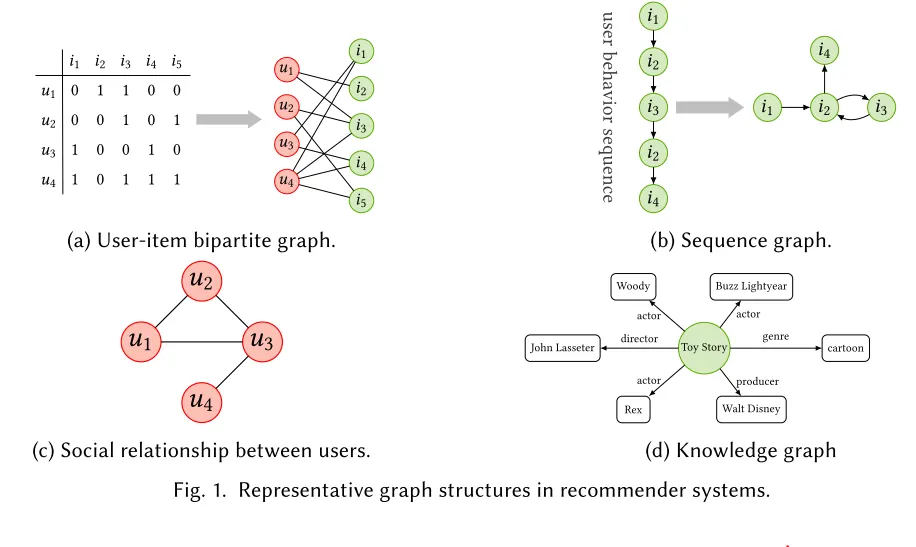

2.1. Recommender Systems

•

Estimate users’ preference for item by the learnt user representation and item representation

•

user-item collaborative filtering recommendation

◦

leverage only the user-item interaction

◦

user representation can be explored by the sequential pattern of her/his historical interactions

•

sequential recommendation(session-based recommendation)

•

social recommendation

•

knowledge graph-based recommendation

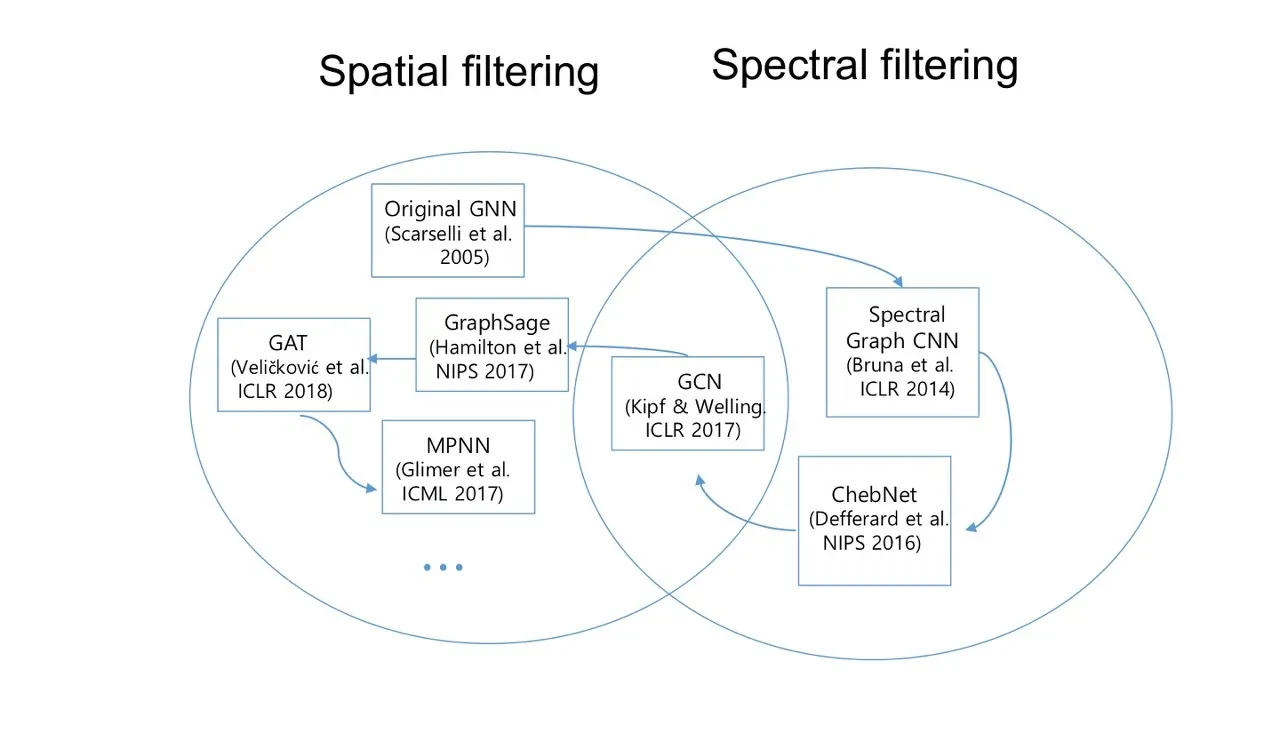

2.2 Graph Neural Network Techniques

•

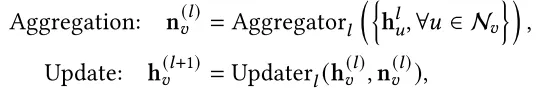

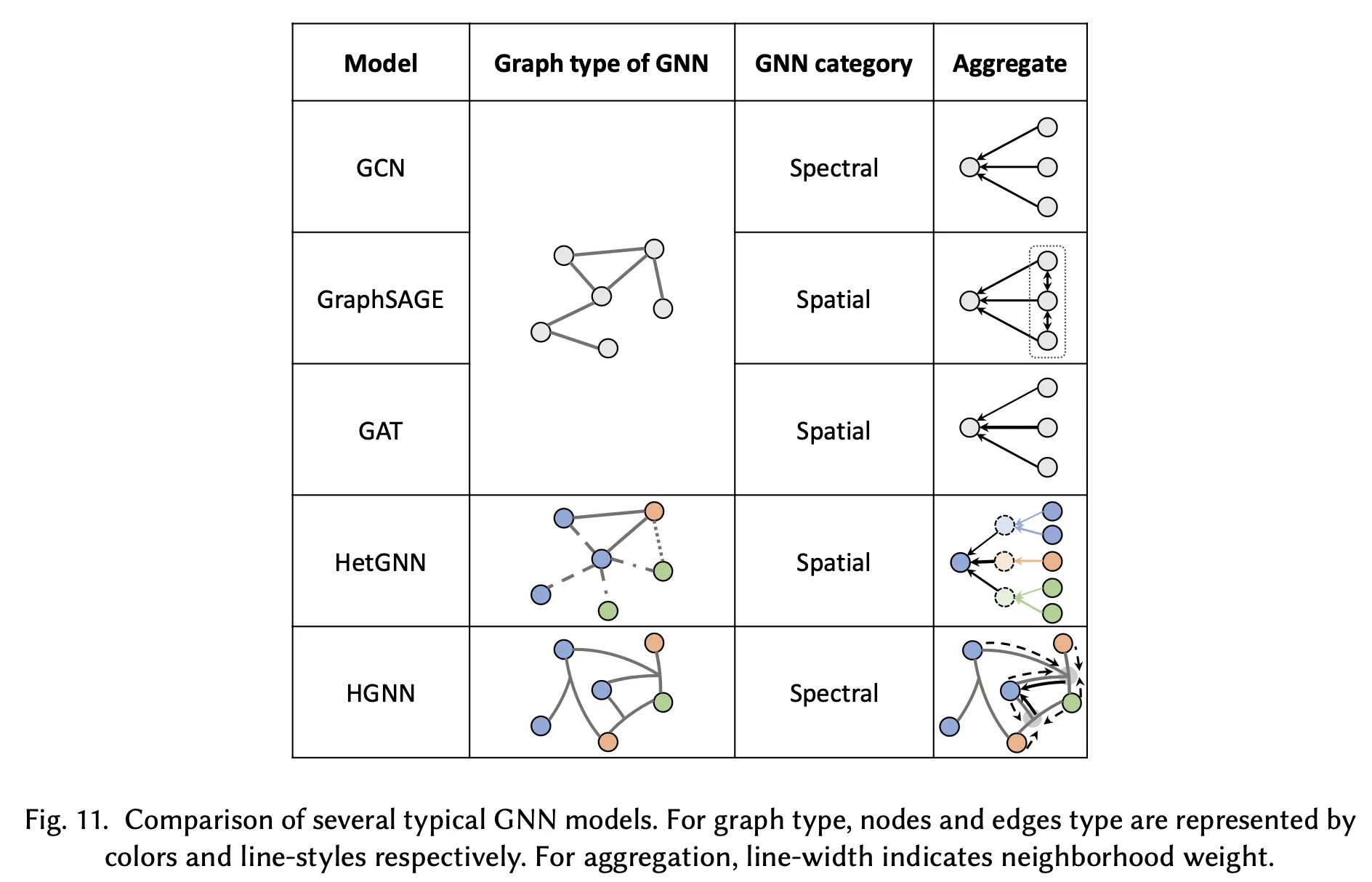

Aggregation and update operations of five typical GNN frameworks

•

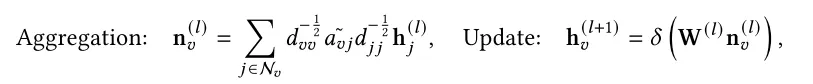

GCN

◦

그래프 라플라시안의 first-order eigendecomposition을 통해 aggregation

•

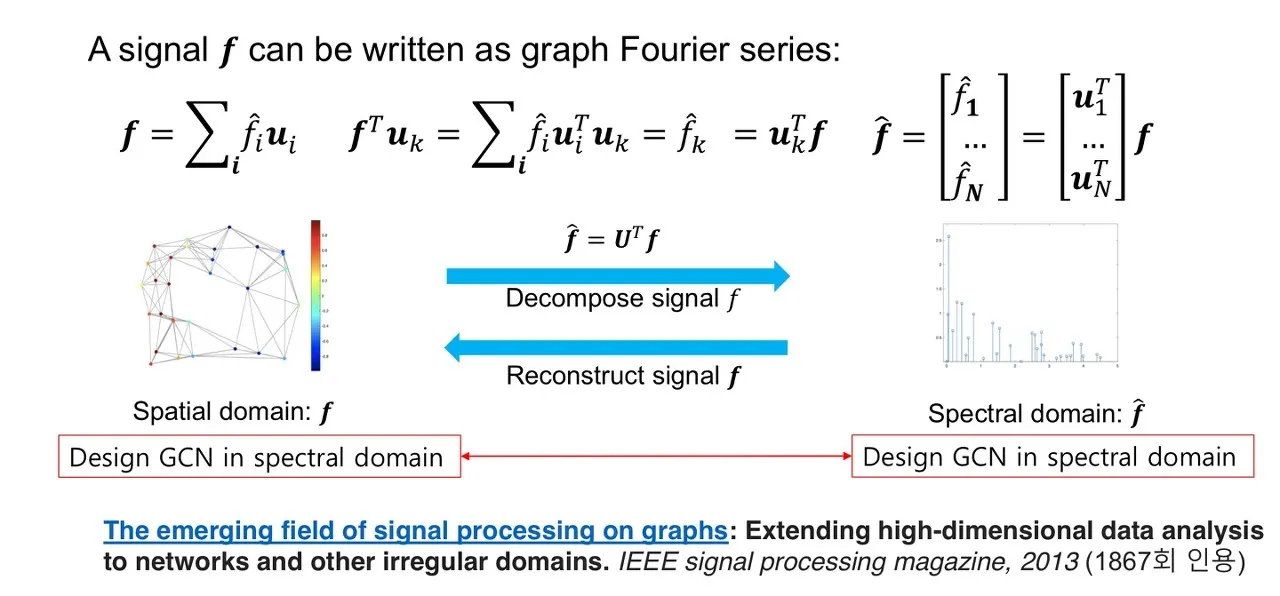

Spectral GCN

1.

기본적인 CNN 연산은 Graph가 Spatial Domain이 아니기에 연산이 불가능

2.

신호처리에서 사용하는 Convolution Theorem을 사용 ( 푸리에 변환 )

3.

이때, graph signal의 푸리에 변환은 graph의 Laplacian matrix를 eigen-decomposition하는 것과 같음

4.

3까지 하면 학습가능한 파라미터가 없는데, 이걸 bruna 2014, Spectral Networks and Locally connected networks on Graph (ICLR) 에서 Diagonal matrix가 원래는 eigen value에 대한 함수인데 이를 학습 가능하도록 바꿈

5.

하지만, 4의 경우 Eigen vector에 대한 의존성이 있어서 이에 대한 의존성을 없애고자 Approximation을 도입

6.

Chebyshev Spectral CNN으로 접근 (Defferrard 2016, CNNs on Graphs with Fast Localized Spectral Filtering, Nips)

7.

6의 방식에서 특정 조건으로 근사한게 GCN

•

ChebNet을 1차 근사 → Spatial-based

•

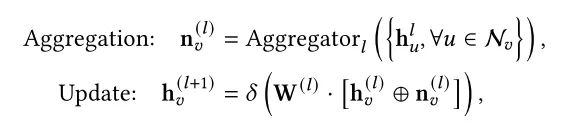

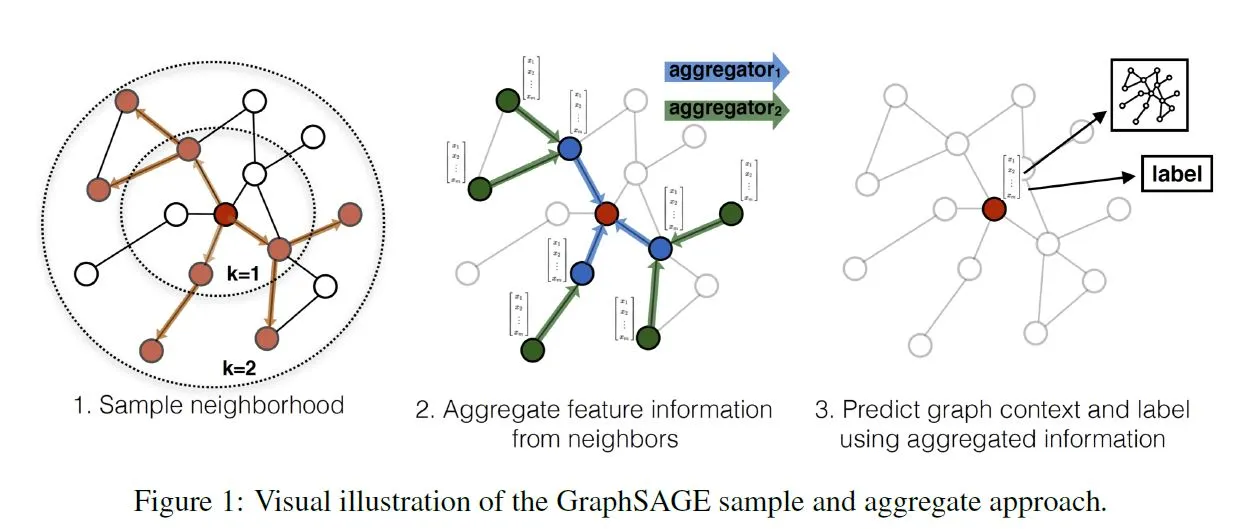

GraphSAGE

◦

기존에는 고정된 단일 graph에 대해 예측 → Transductive

◦

새로운 노드에 대해서도 합리적인 추론을 할 수 있게 → Inductive

◦

이웃 노드의 위상적인 구조를 학습 → 관측되지 않은 노드에 대해서도 일반화 가능

◦

sample a fixed size of neighborhood for each node

◦

mean/sum/max-pooling aggregator

•

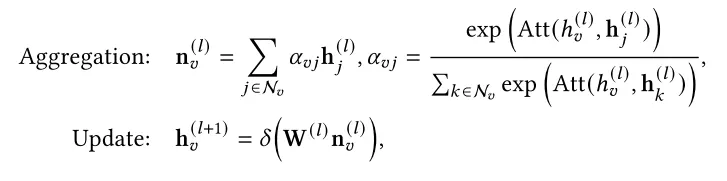

GAT

◦

attention mechanism을 통해 이웃노드들의 가중치를 차별화

•

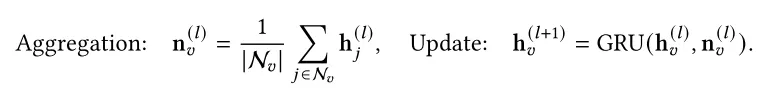

GGNN (Gated Graph Neural Networks)

◦

GRU for updating

•

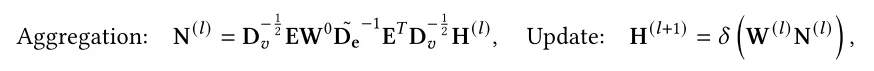

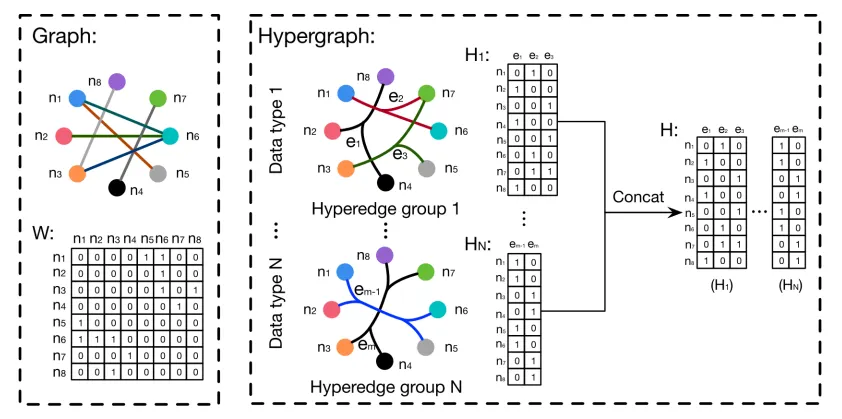

HGNN

◦

hypergraph neural network

2.3 Why Graph Neural Network for Recommendation

•

그래프 데이터의 representation learning에 있어서의 적합성

•

non-sequential data에서의 node representation, sequential data에서의 graph representation(sequence representation) 모두 가능

•

Flexibility to incorporate additional information

◦

Ex. social network graph를 user-item bipartite graph와 함께 표현할 수 있음

•

GNN can encode collaborative signal of user-item interactions

•

Flexible to model multi-hop connectivity